ID:246665

Aurora👾

中朝神经机器翻译

- 公司信息:

- 自然语言处理方向博士在读

- 工作经验:

- 4年

- 兼职日薪:

- 500元/8小时

- 兼职时间:

- 可工作日远程

- 所在区域:

- 北京

- 海淀

技术能力

机器学习,深度学习,tensorflow,pytorch,神经机器翻译等。

电子技术、离散数学、程序设计、数据结构、操作系统、计算机组成原理、微机系统、计算机系统结构、编译原理、计算机网络、数据库系统、软件工程、人工智能、计算机图形学、数字图像处理、计算机通讯原理、多媒体信息处理技术、数字信号处理、计算机控制、网络计算、算法设计与分析、信息安全、应用密码学基础、信息对抗、移动计算、数论与有限域基础、人机界面设计、面向对象程序设计等

项目经验

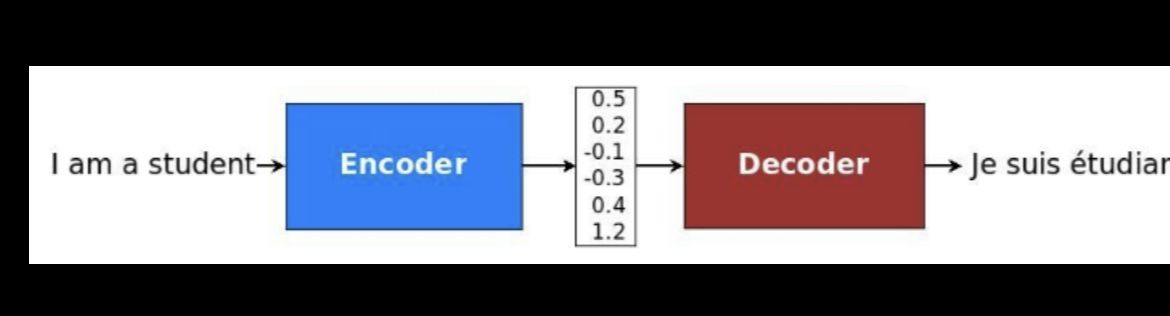

中朝神经机器翻译项目,首先获取语料,然后通过深度学习框架tensorflow进行模型训练,最后得到模型,测试翻译效果。与传统的统计机器翻译不同,NMT的目标是建立一个单一的神经网络,可以共同调整以最大化翻译性能。最近提出的用于神经机器翻译的模型经常属于编码器-解码器这种结构,将源句子编码成固定长度的矢量,解码器从该矢量生成翻译。

案例展示

-

神经机器翻译

编码器-解码器结构----神经机器翻译的通用方法实例。编码器将源语言句子转换成向量,然后通过解码器输出翻译结果。 具体来说,神经机器翻译系统首先使用编码器读取源语言句子,构建一个[思想]向量,即代表句义的一串数字;然后使用解码器处理该容器,并输出翻译结果,如上图所示。这就是我们

-

机器翻译

RNN 可以是单向的或双向的,后者将捕捉双向的长时间依赖关系。 RNN 可以有多个隐藏层,层数的选择对于优化来说至关重要...更深的网络可以学到更多知识,另一方面,训练需要花费很长时间而且可能会过度拟合。 RNN 可以有多个隐藏层,层数的选择对于优化来说至关重要...更深的网

相似人才推荐

-

500元/天无无概要:python爬虫,python数据处理分析可视化。对网站的爬取比较熟练,自动化测试也可以。在读大学生

-

500元/天无无概要:会使用C++、Python,只做自己感兴趣的项目,擅长的方向包括桌面应用开发、计算机视觉、数据处理等

-

500元/天无无概要:精通Photoshop,Dreamweaver,flash,premiere。掌握php,JavaS

-

500元/天工程师泛微概要:2年Java开发(银行系统外包) 5年运维开发工作( 桌面硬件运维,如:电脑,打印机维修,机房维

-

500元/天项目(产品)经理淘鲜购信息科技有限公司概要:有一个开发团队 人员配置齐全 熟练掌握各种开发技术 人员平均工龄5年以上 有丰富的网络开发经验

-

500元/天无无概要:电子信息工程专业学生,掌握python、JAVA、C等语言,可以使用python进行数据采集,数据分

500元/天无无概要:电子信息工程专业学生,掌握python、JAVA、C等语言,可以使用python进行数据采集,数据分 -

500元/天free pascal/delphi开发工程师新大陆信息技术有限公司概要:精通java、python、delphi、c++、c语言开发,针对条码识别、二维码识别、图像内容识别

-

500元/天量化数据分析师Fields金融产业研究院概要:熟练掌握python,java,css,matlab,c,stata,html语言,爬虫,掌握数据分