ID:199879

newplan

研究生

- 公司信息:

- 清华大学

- 工作经验:

- 4年

- 兼职日薪:

- 1000元/8小时

- 兼职时间:

- 下班后

- 周六

- 周日

- 所在区域:

- 北京

- 海淀

技术能力

个人的主要研究高性能计算和分布式机器学习技术,包括系统架构,网络优化,以及算法优化等。熟练使用C/C++编程语言,熟悉Caffe,Pytorch,TensorFlow以及MxNet等深度学习的代码和架构。对于分布式系统有深刻理解和丰富经验。

项目经验

此前,研究端到端的分布式机器学习的性能瓶颈,优化并加速分布式机器学习的性能,提升CPU/GPU的有效计算效率,提升实时在线的分布式机器学习的运行效率,提升云计算的效率。

案例展示

-

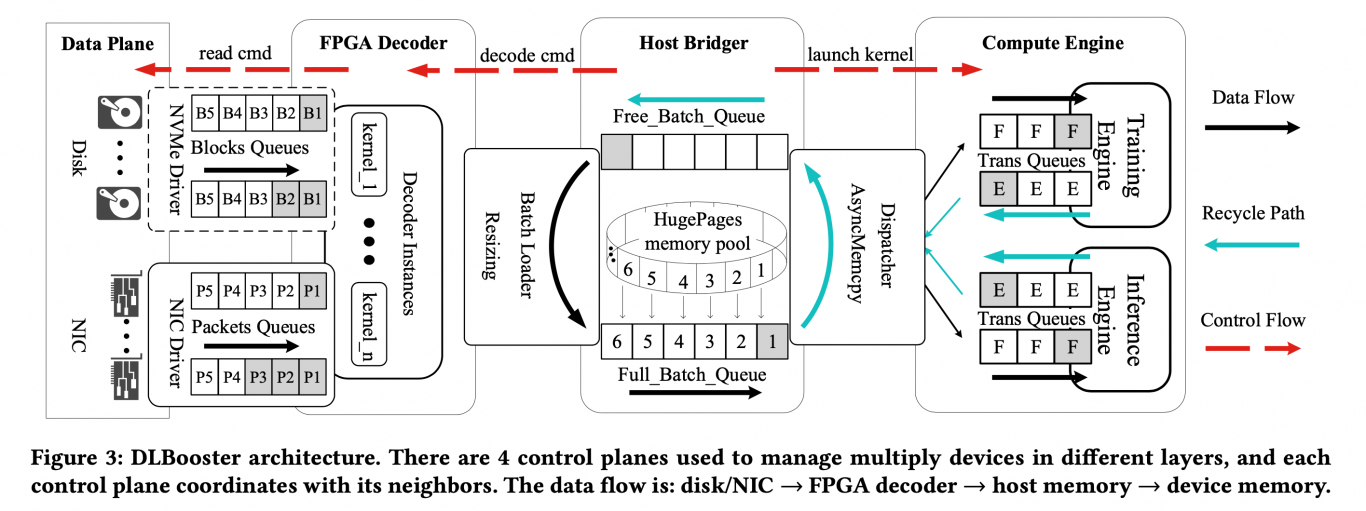

DLBooster

主要研究在云计算环境下的分布式机器学习的端到端性能瓶颈,提出使用FPGA技术提升数据预处理的效率,提升分布式机器学习的效率。

-

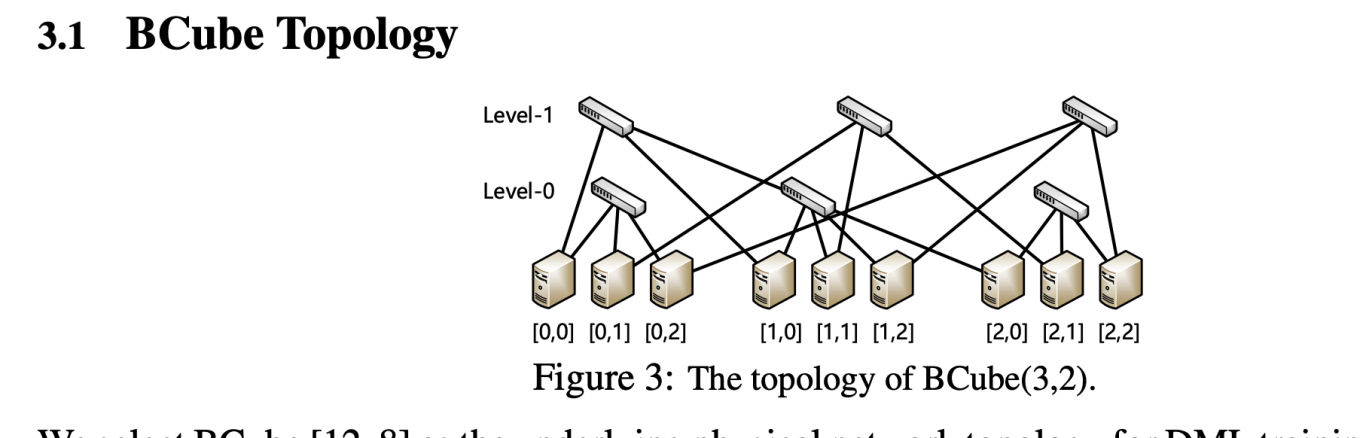

BML

构建基于BCube拓扑的分布式机器学习框架,使用RDMA技术提升数据中心的网络传输效率,集成到TensorFlow系统中,充分发挥并行能力,提升分布式机器学习的效率。

相似人才推荐

-

500元/天PLC工程师日升自动化概要:做过设备维修员,负责厂区内水电气,有低压电工证,初级建构筑消防员资格证。 做过产品设计,设备制作。

500元/天PLC工程师日升自动化概要:做过设备维修员,负责厂区内水电气,有低压电工证,初级建构筑消防员资格证。 做过产品设计,设备制作。 -

500元/天电气工程师武汉精测集团有限公司概要:1、三菱PLC编程、欧姆龙PLC编程 2、EPplan电路图绘制、 3、三菱人机绘制、 pr

-

2000元/天项目经理海尔洗衣概要:在职专业互联网5年大厂团队,在线赚零花,团队豪华阵容,专业。APP及云平台已成功运营5年。流水线作业

-

500元/天在读研究生(生物信息学)广东工业大学概要:主要研究方向是生物信息学, 自己学习了机器学习, 计算机视觉, NLP方面的内容. 常用的开方软件p

-

500元/天大数据工程师上海欧点云科技概要:1、熟练使用 Java 语言,进行大数据开发,熟悉多线程,JVM 及垃圾回收机制。 2、熟练使用

-

500元/天图像处理工程师中船重工鹏力(南京)大气海洋信息系统有限公司概要:从事安防视频方面的图像处理及视频分析,掌握的主要算法包括图像检测、图像分类、图像相似性检索、图像语义

-

500元/天算法工程师平安科技概要:四川大学硕士在校生目前在平安科技实习算法工程师。熟悉语音识别相关算法。熟练使用JAVA Python

-

500元/天爬虫研发工程师博彦概要:主要从事于 python 开发,工作上主要使用 scrapy 框架,有部分反爬虫调试经验,能够逆向一

500元/天爬虫研发工程师博彦概要:主要从事于 python 开发,工作上主要使用 scrapy 框架,有部分反爬虫调试经验,能够逆向一