枫秋落叶 身份已认证

python算法工程师

- 公司信息:

- 中科院

- 工作经验:

- 5年

- 兼职日薪:

- 1000元/8小时

- 兼职时间:

- 下班后

- 周六

- 周日

- 所在区域:

- 深圳

- 宝安

技术能力

我的技术栈包括以下几个方面:

编程语言:

Python:作为主要开发语言,广泛应用于数据处理、机器学习、深度学习和Web开发。

JavaScript:用于前端开发,尤其是基于 Vue.js 的开发。

SQL/NoSQL:用于数据库管理和查询。

前端框架:

Vue.js:用于构建响应式和动态的前端应用,尤其是单页应用(SPA)。

后端框架:

Flask:一个轻量级的 Python Web 框架,适用于小型项目和快速原型开发。

FastAPI:一个现代的高性能 Python Web 框架,主要用于构建高并发的 RESTful API,支持异步编程。

机器学习与深度学习:

TensorFlow、PyTorch:用于构建和训练深度学习模型,应用于自然语言处理(NLP)、计算机视觉(CV)等领域。

scikit-learn:用于传统机器学习任务,如分类、回归和聚类。

Keras:高层次的深度学习库,支持快速构建神经网络模型。

自然语言处理(NLP):

Transformers(Hugging Face):用于实现和训练各种预训练语言模型,如 BERT、GPT 等,处理文本生成、翻译、问答等任务。

NLTK:一个广泛使用的 NLP 库,用于分词、标注和语法分析等。

计算机视觉(CV):

OpenCV:用于图像处理、计算机视觉任务,如人脸识别、目标检测等。

PaddlePaddle、YOLO:用于目标检测和其他深度学习相关的 CV 任务。

数据处理与存储:

Pandas:用于数据清洗和分析。

NumPy:用于数值计算和矩阵操作。

SQL/NoSQL数据库:如 MySQL、MongoDB,用于存储和查询数据。

大模型:

GPT系列(如 OpenAI GPT、ChatGPT):用于自然语言生成、对话系统。

BERT、T5、XLNet:用于文本分类、情感分析、语义理解等任务。

其他工具与库:

Docker:用于容器化部署,确保环境的一致性。

Git/GitHub:版本控制和团队协作工具。

项目经验

基于人工智能的AI问诊导巡大模型项目旨在提升患者的就医效率,缓解医疗资源压力。以下是项目的详细讲解:

遇到的问题:

· 整体架构: 如何在项目框架中选择前后端以及模型api的响应。

· 流式回答:如何实现用户能够获得流式回答,减少模型的响应时间。

· 模型裁决:如何让两个大模型的回答能够自动进行裁决,生成最优的回复。

· 意图识别:如何确保模型能够识别用户的问题是在进行问诊,而非闲聊。

· 信息整合:如何将RAG检索和知识图谱的信息与提示词相结合,提供给大模型用于回复。

项目搭建过程:

· 系统架构:项目使用前端页面与FastAPI框架进行前后端系统搭建,实现无缝交互。

· 数据来源:数据主要来自爬取的医学网站和开源医学对话数据集,用于训练意图识别模型,以准确判断用户输入的意图,分为闲聊和问诊两类。

· 项目流程与LangChain应用结合:

对于闲聊场景,系统直接与大模型进行对话。

对于问诊场景,系统首先检索RAG向量数据库,召回相关文本,并使用命名实体识别技术识别用户提问的疾病 或症状。利用知识图谱(Neo4j)获取相关命名实体识别的科室和症状信息,最终构建提示词模板供大模型使用。

· 模型使用:项目涉及五个模型,包括千问7B和14B的LoRA训练模型、自预训练的意图识别模型、ModelScope中的RAG检索模型和命名实体识别模型。

· VllM部署:所有模型和相关数据均在本地服务器部署,使用VLLM对千问7B和14B模型进行加速推理,实现实时对话功能。

· Agent智能决策:在此基础上,使用本地千问14B的智能体对两个模型的回复进行裁决,模型能够自主判断并返回最优回复给用户。

最终效果:

· 实现了模型的实时回复, 比单次推理快上3秒;

· 使用agent对模型的回复进行裁决, 效果测试接近于人工审核;

· 实现了模型自动思考决策行为+rag和知识图谱的信息作为提示词工程, 减少了模型的幻觉问题;

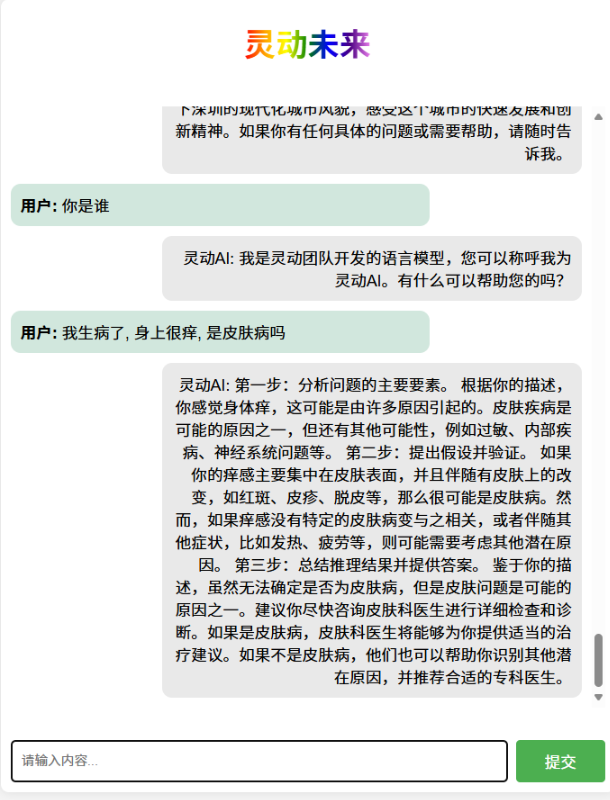

案例展示

-

灵动ai

基于人工智能的AI问诊导巡大模型项目旨在提升患者的就医效率,缓解医疗资源压力。以下是项目的详细讲解: 最终效果: · 实现了模型的实时回复; · 使用agent对模型的回复进行裁决, 效果测试接近于人工审核; · 实现了模型自动思考决策行为+rag和知识图谱的信

-

G60心理干预AI模型

项目搭建过程: · 前端使用vue搭建app和管理后台. 管理后台页面有患者列表、患者训练列表、患者心理量表、患者疑问列表、日训练情况查看等相关页面. app端是用户进行日常训练、疑问求解、以及使用大模型的相关页面. · 后端使用falsk搭建框架, python编写代码

相似人才推荐

-

800元/天AI应用工程师北京世纪互联概要:1.在智能问答系统中,设计和优化了RAG架构,结合检索和生成的优势,提升了生成内容的准确性。 2.

800元/天AI应用工程师北京世纪互联概要:1.在智能问答系统中,设计和优化了RAG架构,结合检索和生成的优势,提升了生成内容的准确性。 2. -

500元/天科研助理哈工大概要:1. 爬虫自动化脚本编写。 有丰富的python爬虫脚本编写经验,爬取过国内外多家服装平台的图片

-

500元/天地信研究生山东师范大学概要:我具有扎实的数据处理和地理信息系统(GIS)分析技能,能够熟练使用Python进行数据清洗、分析和可

-

1000元/天高级开发工程师携愉度概要:Python django flask 爬虫 web app js逆向 spark SQL

-

500元/天无无概要:熟练使用python,现就读于大二 在线接单勤工俭学111111111111111111111111

-

500元/天学生江南大学概要:通过大学英语四级,能够熟练使用各种如word、excel、PowerPoint、PhotoShop等

-

500元/天原信息保障科长内蒙古某部队概要:我专业是通信和计算机方向; 我本科毕业于解放军理工大学,硕士毕业于陆军装甲兵学院,担任过某边防部队的

-

1500元/天研发工程师华为概要:本科为药学专业,研究生为南京大学计算机专业毕业。同时具有药学和IT的专业背景。 在中兴、华为等知名

1500元/天研发工程师华为概要:本科为药学专业,研究生为南京大学计算机专业毕业。同时具有药学和IT的专业背景。 在中兴、华为等知名