文本图片搜索系统

案例介绍

1. 项目概述

深度学习已经逐步从大模型演化为超大模型,数据源也从单模态向多模态发展,虽然前沿的学术进展较为成熟,各个模态数据之间打通也变得较为便利,本软件旨在解决跨模态数据之间的匹配问题,包括文本到图像以及图像到文本,用户可以直接在本软件平台上尝试多模态搜索的强大能力,也可以基于本平台二次定制化开发,更加贴合实际应用的业务场景。

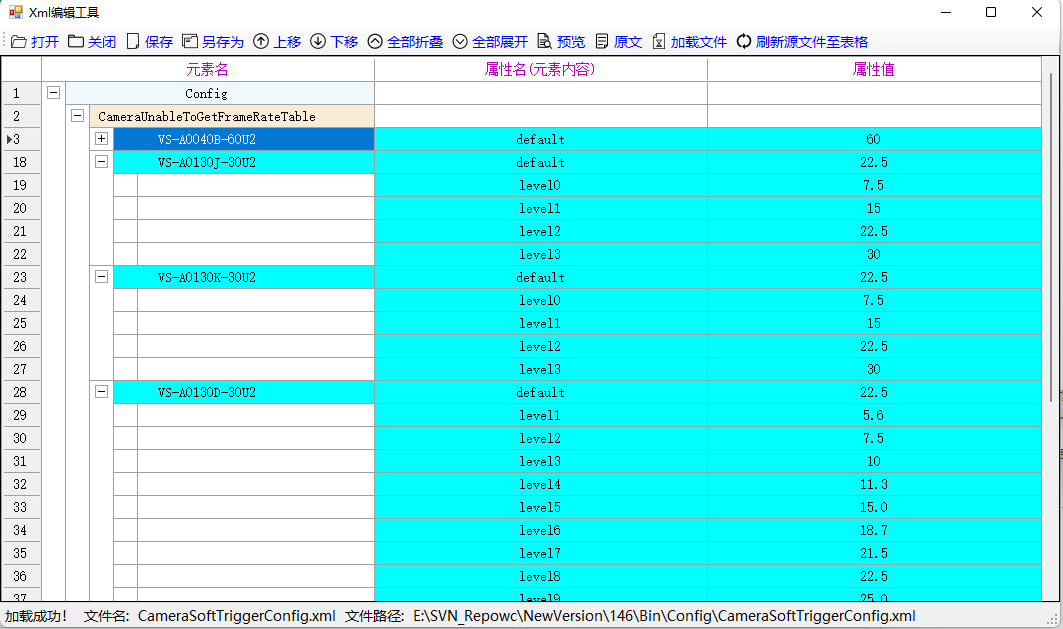

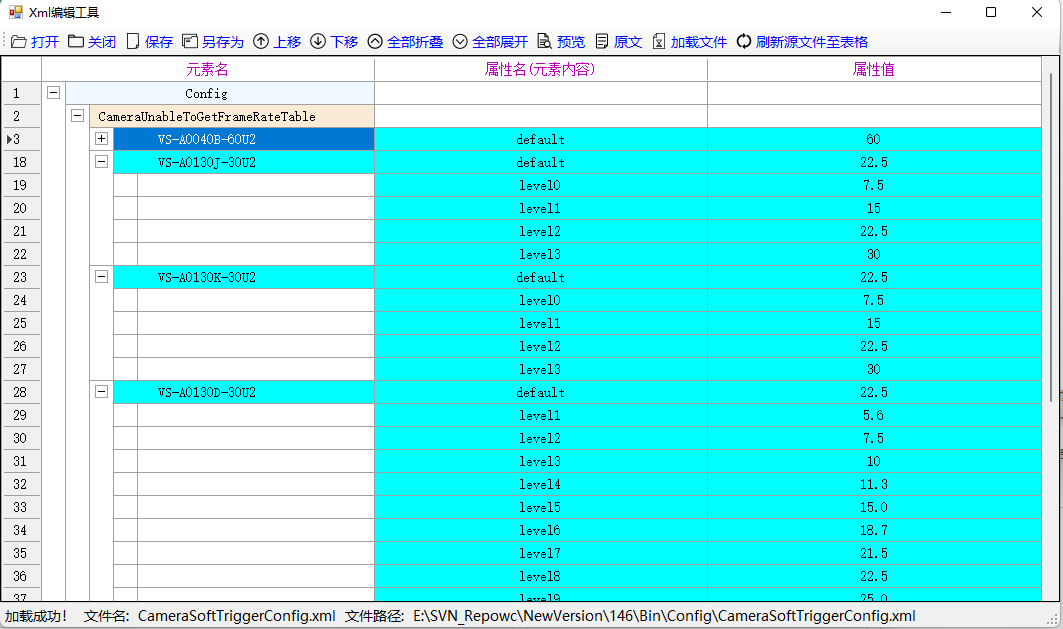

2. 整体架构

本项目重点解决多模态数据之间的匹配问题,如以文搜文、以文搜图、以图搜图、以图搜文等通用应用场景。用户可以根据自己需求结合到实际业务场景中,比如智能客服场景下,需要根据历史问答库来为用户提问匹配最优答案,这就可以使用本软件的以文搜文功能,还比如前端UI设计师需要从素材库里找到想要的图片素材,这就可以使用本软件的以文搜图功能。

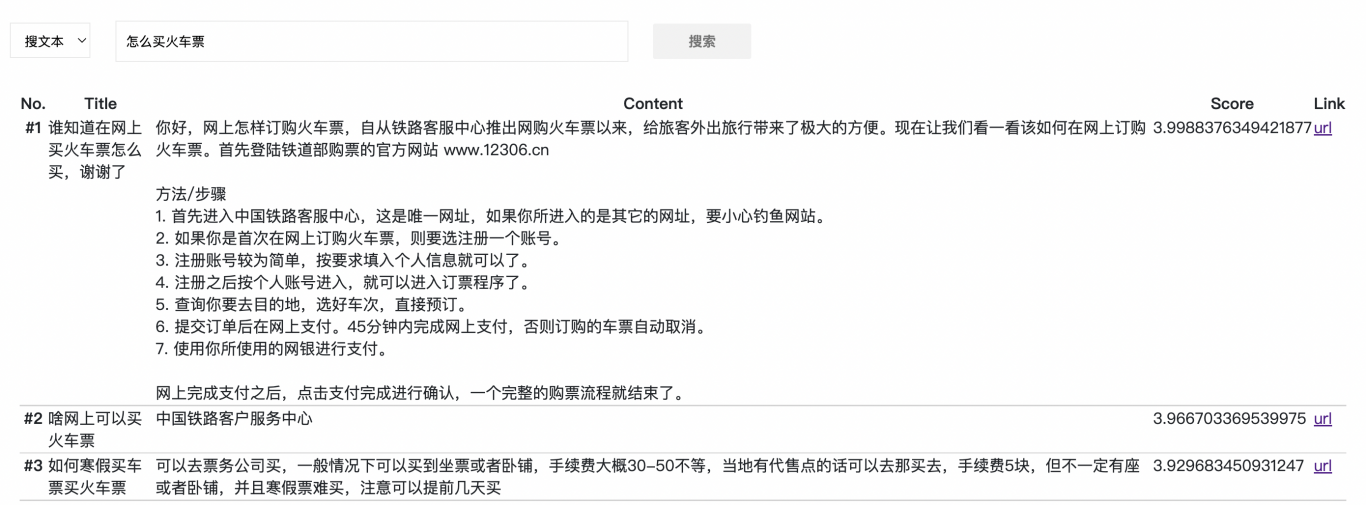

一、以文搜文

支持用户输入文本,多模态匹配平台会根据用户输入的文本跟百科库中进行语义匹配计算,然后返回用户关心的百科内容。

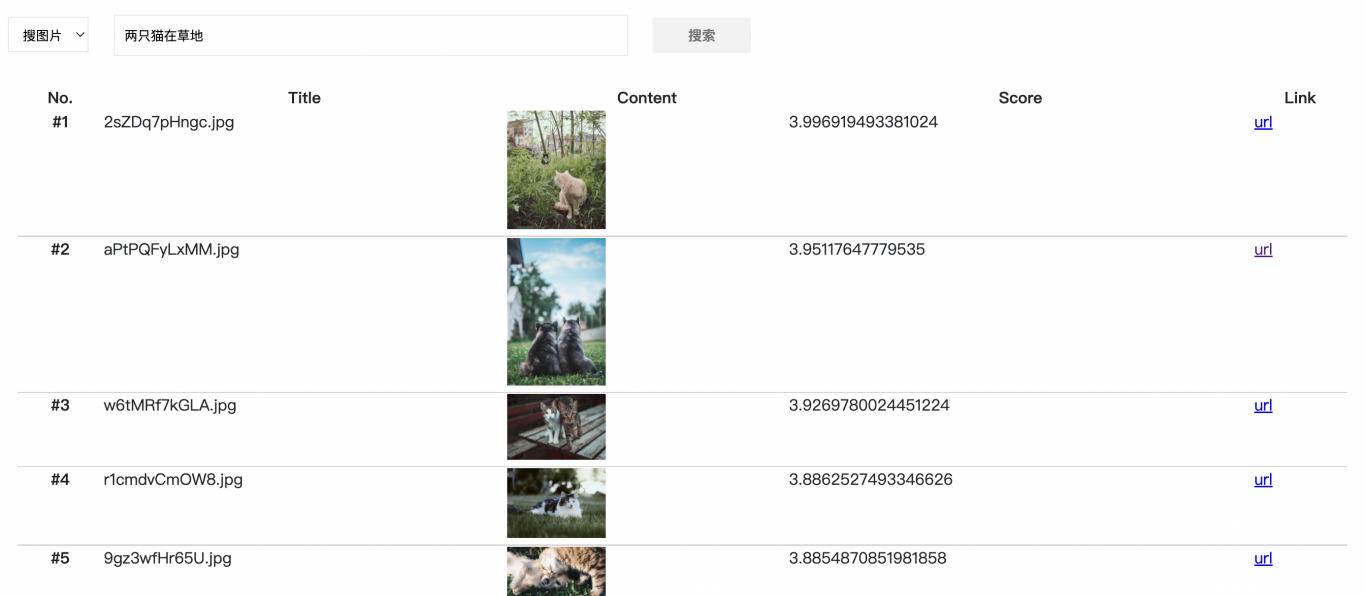

二、以文搜图

支持用户输入文本,多模态匹配平台会从图片库中进行语义匹配计算,然后返回用户想要查找的图片。

三、以图搜图

支持用户输入图片,多模态匹配平台会从图片库中进行语义匹配计算,然后返回跟用户输入近似的图片。比如输入猫,返回的图片也是猫相关的。

四、以图搜文

支持用户输入图片,多模态匹配平台会根据预先内置的 1000 多个文本标签,来计算用户图片跟文本标签的相似性,然后返回文本标签给用户。

3. 核心贡献

完成以文搜文、以文搜图、以图搜图以及以图搜文等四个多模态搜索模块,每个模块都使用了先进的NLP和CV预训练大模型,并且针对特定应用场景给出了 demo 验证样例,是一套从模型到前端搜索交互的完成系统。

4. 难点挑战

同模态和跨模态数据理解存在着极大的挑战,比如文字描述“狗”和真实图片中的“狗”在计算机理解看来天差地别,我在项目中使用了大规模预训练模型,能够透过数据模态形式来理解背后的语义,进而使得文本和图片之间相互搜索成为可能。

案例图片